KI-Entwicklung

23.07.2024, 09:44 Uhr

KI-gestützter Audio-Editor als Beispielprojekt für lokale KI-Anwendungen

Microsoft stellt eine WinUI3-basierte Audio-Editor-App vor, die lokale KI-Modelle nutzt, um Entwicklern die Integration von KI zu demonstrieren.

(Quelle: dotnetpro)

Microsoft hat ein Beispielprojekt veröffentlicht, das Softwareentwicklern zeigen soll, wie sie lokale KI-Modelle in Windows-Anwendungen integrieren können. Die als Audio Editor bezeichnete App, die auf WinUI3 und dem Windows App SDK basiert, demonstriert die Möglichkeiten der On-Device-KI-Verarbeitung.

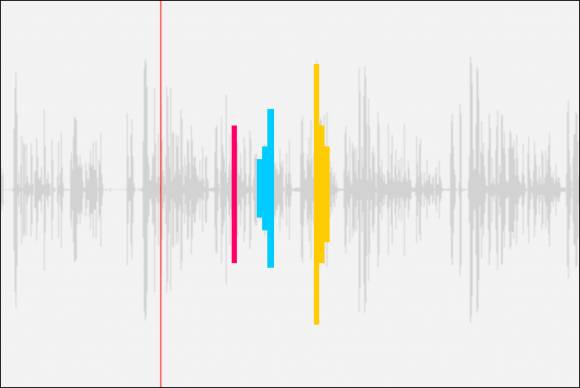

Die Hauptfunktion der App ist das Smart Trimming von Audiodateien. Benutzer können eine Audiodatei hochladen, ein Thema oder Schlüsselwort angeben und eine gewünschte Trimm-Dauer festlegen. Die App generiert daraufhin einen gekürzten Audioclip, der den relevantesten Abschnitt in Bezug auf das angegebene Thema enthält.

Um diese Funktionalität zu ermöglichen, nutzt die App drei verschiedene ONNX-Modelle:

- Silero Voice Activity Detection (VAD): Dieses Modell unterteilt die Audiodatei in kleinere Abschnitte, die von weiteren Modellen verarbeitet werden können.

- Whisper Tiny: Ein Spracherkennungsmodell, das die Audioabschnitte in Text transkribiert.

- MiniLM: Ein Texteinbettungsmodell, das die semantische Ähnlichkeit zwischen dem Thema und den transkribierten Textabschnitten berechnet.

Die Kombination dieser Modelle ermöglicht es der App, den relevantesten Audioabschnitt zu identifizieren und zu extrahieren.

Microsoft stellt den vollständigen Quellcode der Anwendung auf GitHub zur Verfügung, zusammen mit einer detaillierten Anleitung zur Einrichtung und einem Code-Walkthrough. Dies soll Entwicklern helfen, die Implementierung besser zu verstehen und ähnliche Funktionen in ihre eigenen Anwendungen zu integrieren.

Kommentare

Es sind keine Kommentare vorhanden.